Week 2.2023: Digital Transformation, poi ancora ChatGPT, un monito per il futuro prossimo.

Benvenuti alla seconda settimana del 2023 dei Mak's Filez. Ogni settimana leggo decine di pagine di contenuti su Digital Transformation, Digital Marketing AI & dintorni e ve li ripropongo su questa newsletter.

Parliamo di: Digital Transformation, poi ancora ChatGPT, un monito per il futuro prossimo

Questa newsletter è nata per parlare di Digital transformation quindi mi sembra giusto iniziare il 2023 con alcune che nel 2022 non esistevano o quasi.

- Partiamo con la crescita dei sistemi di PKM. Personalmente uso Obsidian.MD per il day by day e creazioni di contenuti e Notion come depository (ho anche una discreta raccolta di prompt per Midjourney). Ma ce ne sono molti altri e tutti stanno sviluppando i propri Bot a supporto. State sintonizzati che ne parlerò molto in futuro.

- Le soluzioni No Code e le soluzioni low code convergeranno grazie all'uso di chatbot che scriveranno i pezzi di codice per noi.

- Parlano di No code e chatbot, ci sarà la nascita della figura del Prompt-Engineer (ne ho gia parlato qui)

- Il Decision Making e condivisione di Modelli potrebbe aumentare di valore (Vi rimando alla newsletter di ModelliMentali.com )

Ancora su ChatGPT

Siamo ancora nella fase di Luna di Miele con ChatGPT, lo capisco e trovo impressionante (in modo negativo) di quanto velocemente abbiamo abbracciato due trend:

- Umanizzazione di ChatGPT

- Fiducia incontrollabile in un sistema che by definition è errato

Umanizzazione di ChatGPT

Se settimana scorsa la moda era far vedere cosa si può fare con ChatGPT, quello di questa settimana sembra l'umanizzazione. Se si cerca su qualche motore di ricerca per paper scientifici (vedi qui cosa dice Semantic Scholar) risultano dei paper in cui l'AI risulta co autore.

prima di commentare vorrei capire se lo hanno fatto come atto di dissenso.

In ogni caso ChatGPT è uno strumento, non credo che nessuno abbia mai inserito la macchina da scrivere tra i co-autori di un paper.

Si può dare ancora più aria ai denti.

Se prima le tue sciocchezze le dicevi al bar e non le ascoltava nessuno poi sono arrivati i social e i siti di Fakenews e Postverità ad amplificare le bestialità.

L'industria delle news di bassa qualità, su cui magari prima o poi dedicherò pure una articolo qui sul blog, è multimilionaria e ha dato il permesso a molte persone con capacità di pensierò da 4-5 elementare di parlare perchè lo hanno letto su un sito.

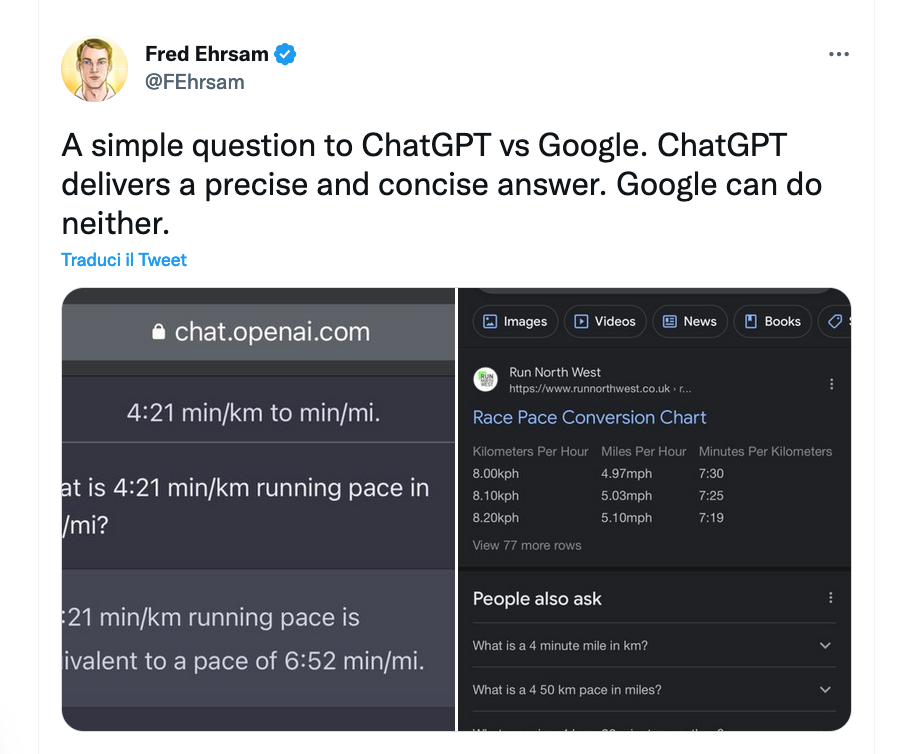

Adesso che ChatGTP è diventata una fonte affidabile non si potrà nemmeno fare un filtro a priori sulle fonti. Per esempio guardate questo tweet in cui l'autore dice sminuisce Google a favore di ChatGpt

Incredibile quale fierezza amplifica la sua ignoranza?

Un prompt di una riga, messa a confronto con dei risultati di google.

Peccato che il risultato sia sbagliato! E non ha nemmeno perso 30 secondi per fare il calcolo*.

Ma è un importantissimo monito per il futuro, ne avevo parlato anni fa su Cocooa.com con il pezzo Ubbedire a pezzo di plasticaccia.

ChatGTP rigurgita le info che gli abbiamo dato e su alcune cose (matematica) è sistematicamente sbagliato, semplicemente perché non è stato istruito per farlo. In futuro migliorerà certamente, ma noi che siamo testimoni dell'origine di tutto ricordiamoci che le AI possono sbagliare e che usarle per gonfiare ancora di più la nostra bolla informativa è uno dei più grossi errori che possiamo fare

a conferma di questo:

Le AI non vogliono dataset creati da AI

Le AI NON vogliono mangiare contenuto creato dalle AI, quindi sembra che già dalla prossima versione di ChatGPT (immagino la 5 dato che la 4 ha già i suoi dataset in cui le AI ancora non avevano impestato il mondo ) ci sia un sistema che permetterebbe di riconoscere ed evitare di usarli come training data. ZeroGTP lo fa e ci sono altri strumenti che controllano questo.

Se siete Content Creator, utilizzate i bot per aiutarvi a fare brain dump delle idee, velocizzare la creazione di mappe mentali, ma non usatelo per scrivere i post.

Member discussion