12 Days of OpenAI, Google AI e gli altri: Dicembre Bollente.

Piccolo annuncio: Credo che questa sia l'ultima mail dell'anno su Manolo.Macchetta.com

Se brami leggere i miei pensieri sparsi è probabile che posterò su https://www.modellimentali.com/ - ModelliMentali.com è il primo sito nel suo genere: Aiuta imprenditori, dirigenti e chiunque voglia alzare il livello di pensiero e ottenere nuovi strumenti per prendere decisioni migliori.

Personalmente sono orgoglioso di quella newsletter quanto lo sono di questa. Se anche tu vuoi arricchire il tuo modo di pensare sarebbe sciocco non iscriversi (è gratuita).

Ma Torniamo a noi

Nell'ultima mail ti scrivevo che avrei parlato di OpenAI solo se ne valeva la pena e comunque solo a evento finito.

Il motivo principale e tentare di gestire questa FOMO che abbiamo, un altro è ragionare a bocce ferme e per ultimo è che OpenAI non è l'unica che ha chiuso l'anno con una mitragliata di novità ed era oggettivamente folle stargli dietro.

Quando OpenAI ha annunciato i "12 giorni di OpenAI" all'inizio di Dicembre, Google si è svegliato e ha messo in moto la sua strategia, decidendo apparentemente di cercare di superare il suo rivale su più fronti. Da un punto di vista tecnico c'è riuscito, dal punto di vista Marketing... continua a puzzare di numero due.

nei giorni in cui OpenAI ha annunciato le giornate Google ha tirato fuori 30 e passa novità.

Facciamo cosi quindi

- Report dettagliato di OpenAI

- Report meno dettagliato di cosa ha tirato fuori Google

- Un bel riassuntone

12 Days of OpenAI

Giorno 1

OpenAI ha dato il via alle danze con il rilascio pubblico di ChatGPT o1, il nuovo LLM che ha risultati ancora migliori in matematica e scienze. Hanno promesso anche una capacità di riconoscimento visivo aumentata.

Ha inoltre annunciato un abbonamento a ChatGPT Pro del valore di 200 dollari.

Giorno 2

questa giornata è stata incentrata sugli sviluppatori con il rilascio di AI Reinforcement Fine-Tuning, che è un metodo per affinare le proprie AI, migliorare il funzionamento dei modelli di intelligenza artificiale attraverso il ragionamento delle risposte.

Giorno 3

Giorno 3: OpenAI ha rilasciato Sora, il suo strumento di generazione di video AI. Le prime impressioni sono state notevoli anche se i limiti sono ancora molti a meno che non abbiate ChatGPT Pro.

Link: sora.com - non accessibile dall'italia

Giorno 4

Giorno 4: Canvas esce dalla fase di beta testing, ed è disponibile a tutti gli utenti di ChatGPT, compresi quelli dei livelli gratuiti. Canvas fornisce un'interfaccia dedicata per progetti di scrittura e codifica estesi oltre il formato standard della chat, ora con un'integrazione diretta nel modello GPT-4o.

Canvas aggiornato consente agli utenti di eseguire codice Python all'interno dell'interfaccia e include una funzione di inserimento di testo per importare contenuti esistenti. MOLTO utile per chi vuole sistemare il codice, o anche imparare a programmare

Giorno 5

OpenAI ha annunciato l'integrazione di ChatGPT con Apple Intelligence su dispositivi iOS, iPadOS e macOS. L'integrazione funziona sui telefoni della serie iPhone 16, sui modelli iPhone 15 Pro, sugli iPad con chip A17 Pro o M1 e successivi e sui Mac con processori M1 o più recenti, con i rispettivi sistemi operativi più recenti.

L'integrazione consente agli utenti di accedere alle funzioni di ChatGPT, compresa l'analisi di immagini e documenti, direttamente attraverso le funzioni di intelligence a livello di sistema di Apple. La funzione funziona con tutti i livelli di abbonamento di ChatGPT e opera nel rispetto della privacy di Apple. I riepiloghi dei messaggi non sono interessati da queste aggiunte. Forse ho capito male ma questo si sovrappone molto alle notizie che già sapevamo sull'integrazione di Apple e ChatGPT

Giorno 6

Il sesto giorno, OpenAI ha creato l'arma finale per le Scam telefoniche. Ha infatti aggiunto due nuove funzionalità alle capacità vocali di ChatGPT: la "videochiamata" con supporto per la condivisione dello schermo per gli abbonati a ChatGPT Plus e Pro, e una voce preimpostata stagionale di Babbo Natale.

Il lancio è previsto per la maggior parte dei paesi non civilizzati, quindi gli Stati membri dell'UE, Svizzera, Islanda, Norvegia e Liechtenstein, avranno accesso in una data successiva. Speriamo il più tardi possibile e comunque quando capiranno come contrastare lo scam prossimo venturo.

Gli utenti aziendali e del settore educativo potranno usufruire di queste funzionalità a partire da gennaio.

Giorno 7

OpenAI ha introdotto i "Project", una nuova funzionalità organizzativa in ChatGPT che di creare cartelle (ooooohhhhh magia) per raggruppare conversazioni e file correlati.

Si creano le cartelle cliccando "+" nella barra laterale, dove possono aggiungere file e istruzioni personalizzate che forniscono contesto per le conversazioni future.

Ho banalizzato un filo perchè oltre alle cartelle questo è il primo passo per il supporto di nuovi tipi di file, l'integrazione con il cloud tramite Google Drive e Microsoft OneDrive, e la compatibilità con altri modelli come o1.

Giorno 7: Questo giorno è stato dedicato all'organizzazione. ChatGPT ha aggiunto i Progetti, un metodo per organizzare le sessioni di ChatGPT.

Giorno 8

OpenAI ha ampliato le funzionalità di ricerca in ChatGPT, estendendo l'accesso a tutti gli utenti con account gratuiti, e riportando miglioramenti in termini di velocità e ottimizzazioni per dispositivi mobili. Anche se SearchGPT non è ancora qui, questo ci va vicino.

L'aggiornamento include una nuova interfaccia per le mappe e l'integrazione con la modalità avanzata vocale, che permette agli utenti di effettuare ricerche durante le conversazioni vocali.

Dal poco che abbiamo potuto vedere la ricerca di ChatGPT si sovrappone molto a quella di Bing, quindi mi ripeto per la terza volta: ottimizzate anche per bing che google vi farà morire.

Giorno 9

Altro giorno dedicato agli sviluppatori: OpenAI ha rilasciato le API per il suo modello o1, aggiungendo il supporto per il chiamato di funzioni, i messaggi per sviluppatori e le capacità di elaborazione visiva. L'azienda ha anche ridotto i prezzi per l'audio GPT-4o del 60% e introdotto una versione mini di GPT-4o, che costa un decimo rispetto alle tariffe audio precedenti.

OpenAI ha semplificato anche l'integrazione di WebRTC per applicazioni in tempo reale e ha svelato il Preference Fine-Tuning, che offre agli sviluppatori nuovi modi per personalizzare i modelli. Inoltre, l'azienda ha lanciato versioni beta dei kit di sviluppo software per i linguaggi di programmazione Go e Java, ampliando così la sua suite di strumenti per sviluppatori.

Giorno 10

Anche se presentato come un giochino la giornata di oggi ha seminato cose davvero importanti: OpenAI ha lanciato l'accesso vocale e tramite messaggi a ChatGPT attraverso un numero verde (1-800-CHATGPT) e WhatsApp.

I residenti negli Stati Uniti possono effettuare chiamate telefoniche con un limite mensile di 15 minuti, mentre gli utenti globali possono inviare messaggi a ChatGPT tramite WhatsApp allo stesso numero.

Se dico Cavallo di Troia abbiamo capito tutti a cosa mi riferisco vero? Se da un lat OpenAi ha capito che potrebbe non vincere la battaglia dei migliori LLM, sa anche che potrà vincere quella del brand.

fare in modo che tutti i boomer e criptoboomer (come i miei amici GenX che vivono nel 1993) accedano e ChatGPT attraverso canali che già usano: WhatsAPP e voce. DIABOLICI.

Giorno 10: Tornando agli annunci divertenti per i consumatori, il decimo giorno OpenAI ci ha regalato l'accessibilità di ChatGPT via WhatsApp. È ora possibile inviare un messaggio a ChatGPT su WhatsApp e anche chiamarlo da un numero di telefono statunitense per una chat in modalità vocale.

Giorno 11

Giovedì, OpenAI ha ampliato l'integrazione dell'app desktop di ChatGPT per Mac includendo vari software di produttività.

OpenAI ha incluso l'integrazione con Apple Notes, Notion e Quip, aggiungendo compatibilità con la modalità avanzata vocale durante l'uso delle applicazioni desktop.

Queste funzionalità richiedono l'attivazione manuale per ogni app e sono disponibili solo per gli abbonati a pagamento.

Giorno 12:

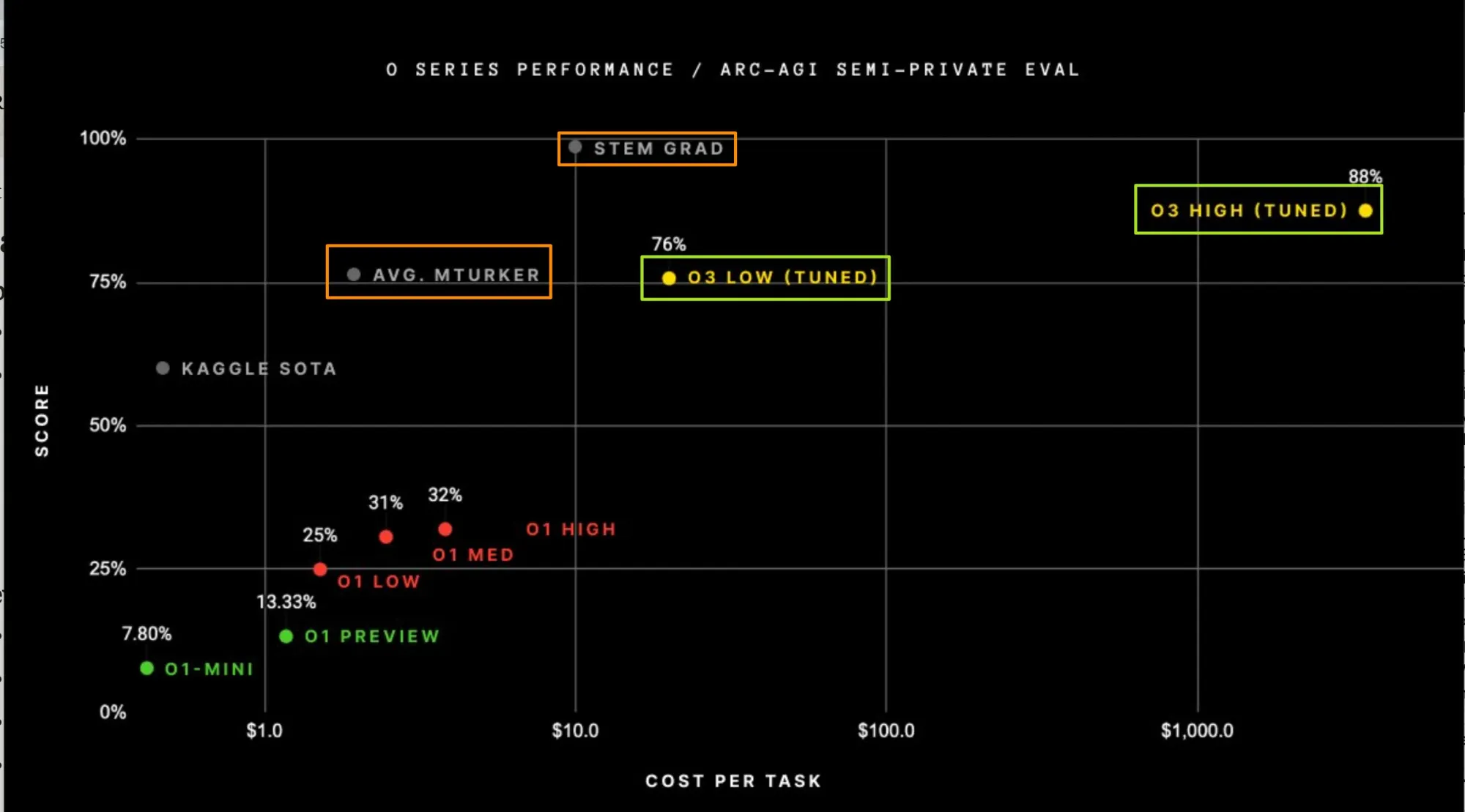

Per il giorno 12 in molti ci aspettavamo l'annuncio di ChatGPT 5, invece è successo un altro fatto potenzialmente epocale. Altman in persona infatti presenta i modelli o3 e o3-mini in una demo in cui sono riusciti a superare il test ARC-AGI. Questo test è stato progettato per non basarsi sulla memorizzazione bensì sulla capacità di calcolo.

Le prime valutazioni mostrano che o3 ha ottenuto dei risultati pazzeschi in una serie di benchmark, superando persino con 85% il test ARC-AGI, che come si evince dal nome è un test per capire quando si raggiungerà l'intelligenza artificiale generale.

Potrebbe essere un percorso che non porta a nulla, ma invero è strepitoso.

E' molto probabile che siamo davvero a un passo dal non essere la specie con più intelletto sulla terra, ma questo succederà una domanica pomeriggio mentre stiamo cucinando due uova ancora in pigiama.

Sarà molto anticlimatica come cosa.

Per ora i costi sono altissimi (oltre a 1000$ ad operazione) e i campi di applicazione sembrano molto ristretti, ma comunque stiamo assistendo per l'ennesima volta dei passi avanti incredibili senza davvero accorgerci di cosa stia succedendo.

OpenAI ha anche pubblicato una ricerca sulla "deliberative alignment", una tecnica utilizzata nello sviluppo di o1. L'azienda non ha annunciato date di rilascio precise per i modelli o3, ma il CEO Sam Altman ha dichiarato che o3-mini potrebbe essere rilasciato a fine gennaio.

GoogleAI

Google ha risposto con una serie senza precedenti di rilasci. Ecco un rapido riepilogo dei principali prodotti AI annunciati da Google:

- Gemini 2.0 Flash: Una versione di prova del modello AI di Google con tempi di risposta più rapidi, costruito per esperienze interattive che utilizzano vari tipi di input e output.

- Gemini 2.0 Flash Thinking Experimental, un nuovo modello AI che utilizza tecniche di "ragionamento" in tempo di esecuzione simili a quelle di o1 di OpenAI per raggiungere un "pensiero più profondo". Questi cosiddetti modelli di ragionamento si differenziano dai modelli AI standard per l'integrazione di cicli di feedback con meccanismi di autocontrollo, Il processo richiede più tempo di calcolo, spesso aggiungendo secondi o minuti ai tempi di risposta.

- Veo 2: Un generatore video che crea clip realistiche in 4K a partire da prompt testuali, con opzioni regolabili per telecamera e riprese. Molti esperti di immagini AI lo considerano il miglior modello di sintesi video finora, in base ai primi risultati. Link

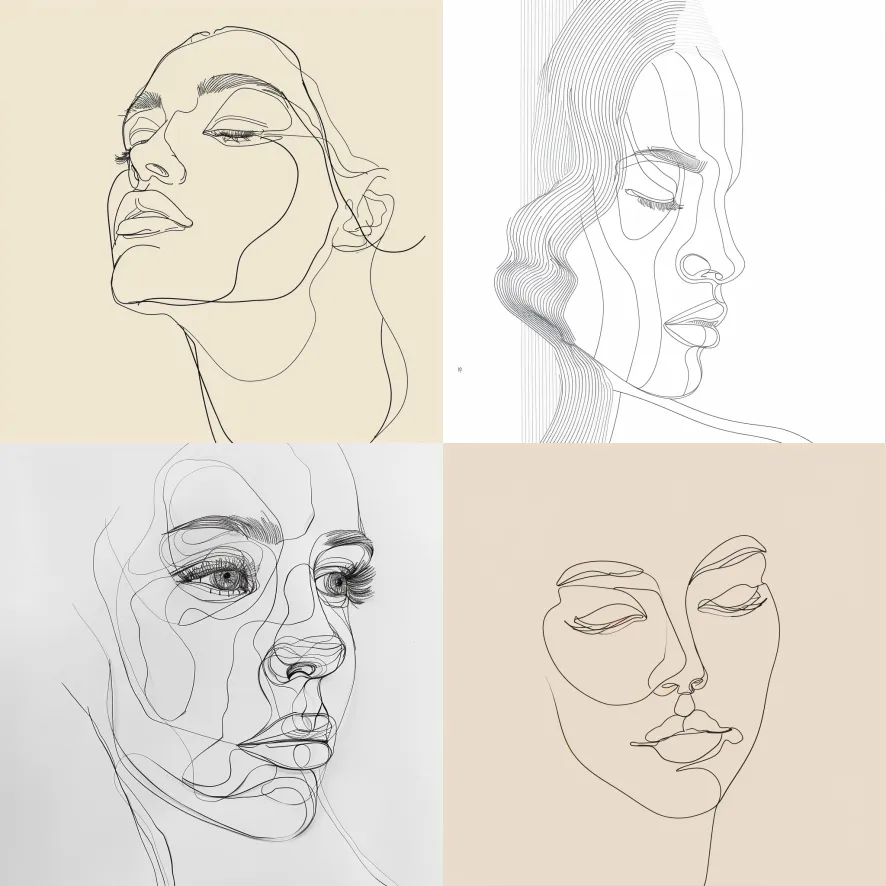

- Imagen 3: Il nuovo modello di Google per la creazione di immagini a partire da testo, che produce immagini con dettagli raffinati, illuminazione e composizione in vari stili artistici. ho provato a fare dei prompt su Midjourney e Imagen, ti lascio i risultati sotto - Link

- Deep Research: Una funzionalità avanzata di Gemini che funge da assistente di ricerca, creando report dettagliati sugli argomenti degli utenti.

- Google Gemini Live demo: Una dimostrazione delle capacità del modello Gemini nell'interagire dal vivo tramite condivisione dello schermo, video e input audio.

- NotebookLM updates: Lo strumento per documenti ora ha una nuova interfaccia per la gestione dei contenuti, host AI per panoramiche audio e NotebookLM Plus con funzionalità extra e limiti più elevati. Questo potrebbe davvero essere una bomba! Link

- Whisk: Uno strumento che consente agli utenti di creare e modificare immagini con soggetti, scene e stili specifici.

- Project Astra updates: Aggiornamenti a un agente AI precedentemente annunciato che utilizza Gemini 2.0 per fornire risposte istantanee tramite i servizi di Google. link

- Project Mariner: Un test di estensione per Chrome che utilizza Gemini 2.0 per aiutare gli utenti a completare attività nel browser comprendendo il contenuto delle pagine.

Alcuni di questi prodotti, in particolare Google Deep Research, Veo 2 e Gemini Live, potrebbero essere uno stepping stone nel campo dell'AI.

Notebook LM

Ognuno di essi avrebbe potuto generare un mese di esperimentazioni, notizie e analisi. Ma sono stati rilasciati in rapida successione, creando un enorme flusso di notizie rischiando pure di far perdere loro il peso.

Qualche Demo: VEO 2

Prompt: The camera floats gently through rows of pastel-painted wooden beehives, buzzing honeybees gliding in and out of frame. The motion settles on the refined farmer standing at the center, his pristine white beekeeping suit gleaming in the golden afternoon light. He lifts a jar of honey, tilting it slightly to catch the light. Behind him, tall sunflowers sway rhythmically in the breeze, their petals glowing in the warm sunlight. The camera tilts upward to reveal a retro farmhouse with mint-green shutters, its walls dappled with shadows from swaying trees. Shot with a 35mm lens on Kodak Portra 400 film, the golden light creates rich textures on the farmer’s gloves, marmalade jar, and weathered wood of the beehives.Prompt: The camera floats gently through rows of pastel-painted wooden beehives, buzzing honeybees gliding in and out of frame. The motion settles on the refined farmer standing at the center, his pristine white beekeeping suit gleaming in the golden afternoon light. He lifts a jar of honey, tilting it slightly to catch the light. Behind him, tall sunflowers sway rhythmically in the breeze, their petals glowing in the warm sunlight. The camera tilts upward to reveal a retro farmhouse with mint-green shutters, its walls dappled with shadows from swaying trees. Shot with a 35mm lens on Kodak Portra 400 film, the golden light creates rich textures on the farmer’s gloves, marmalade jar, and weathered wood of the beehives.

Midjouney vs Imagen 3

non è un confronto corretto perchè ho usato prompt per midjourney su imagen e non avendo la licenza pro non posso generare visi su Google.

In generale direi che Imagen è MOLTO più fedele ai prompt

Midjourney

Imagen 3

E gli altri

Sono in overdose informativa io che ho assorbito queste news in 2 settimane, non immagino te. Aggiungo solo che la rafficata non si limita solo a OpenAI e Google. Il 6 dicembre, Meta ha lanciato il modello Llama 3.3 70B-Instruct che è in grado di offrire prestazioni paragonabili a quelle dei modelli "di classe GPT-4", anche su hardware consumer. (Appena cambio computer me lo installo, promesso!)

Pochi giorni prima, il 4 dicembre, Amazon è entrata nel gioco con la sua famiglia di modelli multi-modali Nova, posizionandosi con prezzi competitivi rispetto alla serie Gemini 1.5 di Google.

Video

Solo nell'ultima settimana, abbiamo assistito al rilascio o all'annuncio di Sora di OpenAI, Pika 2 di Pika AI, Veo 2 di Google e video-01-live di Minimax. È davvero difficile stare al passo, e ancora più difficile testare tutti questi modelli. Ma recentemente, è uscito un nuovo modello di sintesi video AI open-weights, il HunyuanVideo di Tencent, ed è sorprendentemente capace per essere un modello "gratuito". Link

Cosa possiamo portarci a casa

- o3 arriva pochi mesi dopo o1. I modelli linguistici hanno raggiunto più o meno il tetto al momento: hanno bisogno di tantissima potenza di calcolo e mesi per sviluppare la generazione sucessiva. ChatGPT 5, Anthropic 4, Gemini 3 arriveranno ma con molta più lentezza rispetto a questi.

- Il plateau raggiunto dagli LLM non tocca i modelli multimodali che invece stanno crescendo sempre di più: video, voce

- Siamo in piena esponenziale: ChatGPT 4 costava 3600$ per un milione di token nemmeno due anni fa. DeepSeek, LLM cinese costa 0.14$ per milione di token

- API, fine tuning e tutto il resto sono un segnale chiaro per gli sviluppatori: andare e procreate!

- GoogleAI / DeepMind è una miniera e ha sotto le mani cose incredibili.

- GoogleAI è pessimo nel marketing

- Nel 2025 tantissimi diranno di aver raggiunto l'AGI, senza però darne definizione.

- Link per approfondire: https://openai.com/12-days/

Member discussion