Episodio 56.2025: DNA & Robots, Papiri & Newsletter.

Volevo uscire settimana scorsa, ma sto facendo delle docenze e queste mi stanno prendendo molte più energie di quanto programmato (e sono un ottimo memento del perché posso dedicare non più del 30% del mio tempo alla formazione).

La sezione dedicata agli aggiornamenti di OpenAI è stata relegata nella sezione breve: questo episodio ha infatti come articolo principale i robot umanoidi (che mi ostino a chiamare Androidi). Vediamo a che punto siamo e come si distinguono i vari livelli di sviluppo.

Poi parliamo dei cambiamenti di Substack, del Fallimento di 23&Me, torno a parlare dei Vesuvius Challenge (in cui si sfruttano le AI per leggere i papiri carbonizzati di Ercolano).

Chiudiamo con la consueta Gragnuola di novità con alcune davvero potenti (Nessuno parla del MCP ed errano assai).

Mi sono anche accorto di avere tantissimi contenuti monotematici quasi pronti, che per lunghezza, e necessità di essere aggiornati negli anni meritano un articolo a parte tutto per loro: è probabile quindi che alternerò un Mak's File con un articolo di approfondimento.

L'ho fatto col Code Vibing, lo farò con l MCP. Parlerò di #Digital Transformation, ma anche di #Marketing.

Ah! mi sto rileggendo il Conte di Montecristo, quindi se uso dei termini dell'800 sai anche il perchè.

Substack fa un altro passo per diventare un social network.

Substack è probabilmente il maggior player nel mercato del blog+newsletter integrati (lo stesso di BiiHiv e GhostOrg). Un anno fa ha introdotto la possibilità dei video nativi, che ha un senso per i creators in verticali specifiche che producono contenuti premium (mi vengono in mente divulgatori e giornalisti).

Da questo mese c'è la possibilità che sul proprio feed appaiano, oltre al microblogging, anche degli short, presi proprio dal database di video caricati.

Il tempismo è perfetto con il probabile prossimo ban di Tiktok, che alla data attuale non ha ancora trovato un compratore.

Le possibilità di viralità sono al momento poche, Le possibilità di viralità sono basse, ma potrebbero permettere a molti creator di infilarsi nei radar giusti. Magari non esplodi, ma ti trovi i fan hardcore. E a volte basta quello.

Prometto di fare in futuro un articolo su:

- Quali nicchie potrebbero prosperare con una newsletter (scritta al 50%)

- Cosa usare tra Substack vs Beehive vs Ghost (fatto la mappa mentale)

- Cosa è activitypub e come utilizzarlo (qui ho ancora troppe domande per poter scrivere qualcosa che dia del valore)

Su activity pub ho già avuto due richieste, per gli altri?

23&Me è in fallimento. Cosa succederà al mio DNA?

23&Me, famosa azienda che sequenzia il DNA è in stato di amministrazione controllata. Dal sito dicono "Tranzilli, business as usual" .

Sappiamo bene che business as usual vuol dire "non sappiamo cosa succederà domani."

Gli iscritti sono un po' più preoccupati che i propri dati genetici siano venduti al miglior offerente o che il nuovo padrone sia più sbarazzino sulla condivisione degli stessi.

Al momento è ancora possibile fare l'export dei propri dati per poi cancellare l'account (update: io l ho chiesto da una settimana e ancora non mi è arrivato)

Per non saper ne leggere ne scrivere, anche se potrebbe essere troppo tardi io mi sa che cancello tutto.

Come esportare i dati da 23&Me.

Fai login, in alto al sinistra sul tuo avatar seleziona Settings, poi scrolla in basso fino a "23andMe Data" - View.

ti sarà un controllo sulla data di nascita, e da li potrai scaricare tutto.

La XPeng Motors pianifica di rilasciare il suo androide entro il 2026.

Uso la scusa di questa notizia per parlare di altre cose.

La prima è che un'altra azienda di automobili (dopo la Tesla) è pronta a scommettere su robot umanoidi sicura della potenza dei dati raccolti grazie alle proprio auto a guida autonoma. Le auto a guida autonoma XPeng usano Lidar, radar e visone, quelle di Tesla invece funzionano solo con la visione.

He Xiaopeng, presidente dell'azienda ha detto che i suoi androidi saranno classificati con Tecnologia L3 e che vorranno anni prima di poter sviluppare una vera tecnologia L4.

Dice che un Robot L4 ha bisogno di più di 10 volte i dati rispetto a un'automobile, rendendo il salto generazione complesso anche da un punto di vista di calcoli.

Questo mi fa da gancio alla seconda domanda:

Che diamine è un robot L3 e uno L4?

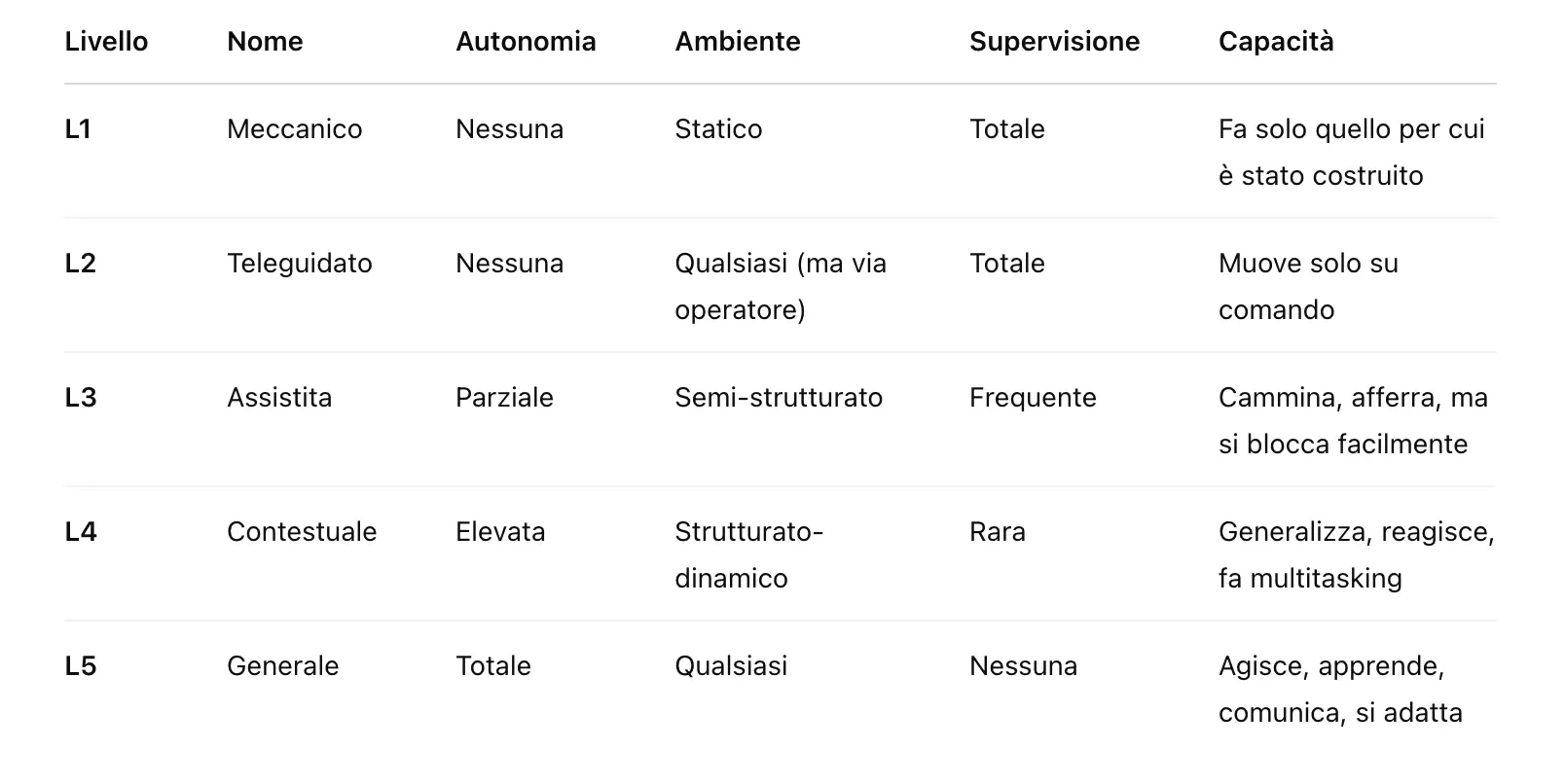

Anche se - obviously - non esiste una definizione univoca il livello di sofisticazione di un robot è diviso in 5 livelli:

Esempi Robot

Livello 1 — Robot Meccanico

Fanno solo quello per cui sono stato costruito, nessuna autonomia decisionale, ciechi verso l'ambiente, nessuna flessibiltà. un po come il vostro vicino di casa ingegnere che fa il quadro alla Megaditta (cit)

Questi sono i robot “toolizzati”, ovvero bracci meccanici che fanno una cosa sola tipo saldare una portiera, versare una pozione in laboratorio, piegare una lamiera.

Anche la lavatrice è a ben vedere un robot L1 : fa il ciclo e basta.

Livello 2 — Teleoperato

Sono i robot Operati da remoto: il Robonaut sull'ISS guidato dall'astronauta all'interno della base spaziale, il braccio teleguidato dal chirurgo italiano che opera un paziente in indonesia, il drone che sta bombardando civili in medio oriente ma l'operatore è in ciabatte in qualche base in Europa sono tutti esempi di L2 Robot.

Sono ideali per contesti pericolosi o complessi, dove serve la precisione di un robot, ma l’intelligenza di un umano. O almeno così speriamo. Se vogliamo usare una metafora sono dei burattini.

Livello 3 — Autonomia Assistita

A questo livello incomincia una specie di libertà. Riescono a eseguire alcuni compiti in ambienti semi strutturati, possono camminare, saltare, prendere oggetti. Generalmente funzionano abbastanza bene fino a quando succede qualche imprevisto. Tesla Optimus Gen 1, Boston Dynamics...

Livello 4 — Autonomia Contestuale

A questo livello il robot riesce ad avere una buona autonomia negli ambienti che gli sono familiari, riconosce problemi e può risolverli, può anche spingersi un po' fuori dalla zona di comfort e tendenzialmente è quello che possiamo aspettarci da un robot (per esempio i badandi robot faranno parte di questa categoria).

I robot della Figure promettono di fare questo, e così anche Apollo di Apptronik. Ovviamente le promesse stanno a zero se non supportate dalla realtà dei fatti. L'Optimus di Tesla visto all'ultima presentazione non aveva ancora raggiunto questo stadio (probabilmente nemmeno L3).

Livello 5 — Autonomia Generale

Quando vedi un film di fantascienza stai vendendo un robot L5: autonomo ovunque, capacità di adattarsi ai problemi mentre questi arrivano. Crea soluzioni: è il maggiordomo che ti sistema le tasse, che guida l'auto, lava i piatti e cucina. Punto di Convergenza tra robotica e molte tipologie di AI, magari con AGI già raggiunta

Ovviamente non esiste se non appunto sui libri e prima di pensare di vedere qualcosa del genere dovremo aspettare un bel po' (che data la velocità attuale direi 7-8 giorni :-P )

Tabella riassuntiva Livelli Robot

Ho chiesto a chatGPT di generare un mega tabellone in Markdown con le mie informazioni qua sopra e di arricchirlo, te lo ripropongo:

Parliamo ancora un attimo di auto a guida autonoma

Per tornare a bomba sulla prima parte: le auto a guida autonoma della Tesla hanno soltanto la visione, simulando l'essere umano e non utilizzano Radar e Lidar.

Musk si è incaponito su questa cosa, tanto che sta perdendo la corsa contro i suoi avversari.

La scelta, che sembrava corretta quando la Tecnologia Lidar era agli inizi, si sta rivelando fallimentare al momento (i Taxi Waymo stanno già operando dove i RoboTaxi Tesla no) ma potrebbe essere la chiave per arrivare primi sul mercato gigantesco degli androidi dato che gli Optimus si muovono senza bisogno di altri gingilli. Di RoboTaxi ne parlerò tra qualche tempo.

Vesuvius Challenge. A che punto siamo

Credo di essere stato uno dei primi a parlare del Vesuvius Challenge. Dopo un annetto ti aggiorno su un po' di cose: le probabilità di leggere dei testi persi nelle pieghe della storia sono altissime.

A che punto siamo

Nell'ultimo aggiornamento eravamo arrivati a leggere una pagina di un papiro. Nel frattempo sono stati ottimizzati i sistemi di riconoscimento dei caratteri, nuovi tool di labelling ed è anche migliorata la gestione degli scan 3D che ha permesso di creare nuovi dataset.

Se quindi c'è stato uno stop nel produrre nuove traduzioni, possiamo vedere come nuovo dataset+ nuovi modelli sono una nuova stepping stone da cui partire.

Questo ci serve per tenere sempre a mente come i progressi sono sempre frutto di più scoperte contestuali (oltre a ribadire che la qualità dei dati in ingresso è vitale)

La Gragnuola di New

Il protocollo MCP diventa lo standard ?

Sia Microsoft che OpenAI hanno aderito al protocollo MCP di Anthropic. MCP permette di far interagire le AI coi database senza dover scrivere API specifiche.

È una rivoluzione silenziosa, tipo il momento in cui ti accorgi che puoi parlare col database senza smoccolare sulle API. Ne parlerò meglio, ma segnatelo: cambia tutto.

OpenAI ha rilasciato, un nuovo modello di creazione di immagini. E' davvero molto potente, con funzioni di outpanting e scrittura testi incredibili.

Il mondo l'ha usato per generare immagini stile Ghibli disonorare il pensiero di Miyazaki. Midjourney ha rilasciato una settimana dopo la versione 7.

Dai primi esperimenti mi è sembrato un rilascio di una beta: A parte la personalizzazione e l'aderenza agli stili non ci sono grossi miglioramenti rispetto alla 6.x (che era comunque già a un livello pazzesco), ed anzi ho notato che il problema di mutanti con dita e piedi extra è pure peggiorato.

A confermare la mia impressione dall'account di X, Midjourney ci fa sapere che ci saranno cambiamenti continui nelle prossime settimane.

Come al solito OpenAi forza la mano al mondo.

xAi compra X

Nell'episodio 54 ho provato a guardare l'acquisto da parte di Musk di Tweeter da un punto di vista diverso della solita narrazione. In un prevedibilissimo colpo di scena xAi di Musk acquista X di Musk per 33Bilions.

In questo modo alza la valutazione X, aumenta il valore complessivo di xAI (che arriva a 80B) riesce a scaricare un po' di debiti e da speranza agli investitori che vedono delle sinergie tra i dati di Twitter (comunque una cloaca) e Grok.

Cosa sara delle AI nel futuro?

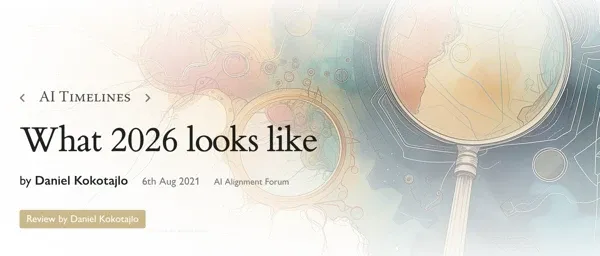

Su LessWrong nel 2021 è apparsa una Timeline dello sviluppo delle AI generative fino al 2026. L'autore, Daniel Kokotajlo, era in OpenAI quando l'ha scritto e devo dire che fin'ora ci ha azzeccato parecchio.

Insieme ad altri autori ha appena pubblicato un altro articolo, molto più lungo e complesso, quasi in forma di racconto che allunga l'orizzonte temporale delle AI. Lo trovi qui: ai-2027.com - Leggilo perchè sono sicuro che lo ruberanno in tantissimi, spacciandolo per loro.

Scopely, io scelgo te!

Ti ricordi di Pokemon Go? Il gioco qualche anno fa ha fatto scoprire al mondo i giochi in Realtà Aumentata e ha ancora adesso 20 milioni di utenti attivi settimanali.

La Niantic, studio che ha sviluppato il gioco, ha venduto la sezione PokemonGo a un fondo chiamato Scopely per 4.9 miliardi. Niantic ha comunque un'azienda spin-off, Niantic Spatial che sta piano piano creando una mappa 3D del mondo grazie ai dati dei giocatori e promette applicazioni interessanti per il futuro. La Scopely a sua volta appartiene al Public Investment Fund (PIF) dell'Arabia Saudita che ha circa il 40% del mercato degli esport.

Manus disponibile (quasi) a tutti.

Manus, l'agente AI che un mesetto ha stupito molti con le sue integrazioni apre a moltissimi in waiting list. Non ho ancora avuto modo di provarlo come merita, ma stai sicuro che lo proverò e se vale ne parlerò nelle prossime puntate.

Il principale aereoporto Europeo non ha un piano B.

Nel 2025, il principale aeroporto europeo, Heathrow, si ferma per un guasto a una singola sottostazione elettrica. Danni per milioni di euro.

Come è possibile che un'infrastruttura abbia un solo esempio di single point of failure? non ci sono sistemi ridondanti?

La risposta è no. E' più facile tagliare tutti i sistemi di sicurezza e quando succede l'improbabile dire che era una sorpresa che investire nel coprire queste fragilità strutturali.

Anche questa cosa lasciamola qui appesa.

Chip RISC in Cina

Un bel po' di tempo fa vi ho parlato dei Chip RISC open source. Sembra che i primi a spingere sull'abbracciare la cosa siano i cinesi: si entra nella fase due della guerra dei chip.

Recente la notizia della taiwanese TSMC di investire 100 miliardi negli USA per produrre chip, a cui segue questa, a cui Huawei e Alibaba hanno già dato il supporto

Sarà interessante vedere come evolverà un HarmonyOS su un RISC-V (ne parlavo nei MakFile di Novembre)

Il COVID ha cambiato il mondo? Vediamo le infografiche

Sono già passati 5 anni dallo tsunami Covid. Come è cambiato il mondo? Ce lo racconta il NYTimes (giusto per confermare quello scritto la scorsa newsletter: qualche giornale che fa il proprio lavoro c'è) in 30 grafiche tipo questa sul numero di nuove azienzde aperte negli usa. Link.

Ho chiuso questo episodio con più tab aperti di quante ne avessi all’inizio.

Ma se anche tu sei arrivato fin qui, qualcosa ti ha smosso.

E questa, lo sai, era solo la parte emersa.

Tra un Mak’s File e un monografico, ci sono altre cose di cui non ho parlato.

Ma ci arrivo. Una alla volta.

Se ti è piaciuto, giralo a qualcuno che vive nel feed sbagliato.

O invita chi sai che capirebbe.

Più siamo, più domande belle ci toccano.

Abrazo,

Manolo

Member discussion